Deepfake: Bill Hader imitiert Tom Cruise – Unterhaltung oder Gefahr?

Ein neues “Deepfake”-Video sorgt für Diskussionen im Netz. Bill Hader ahmt Tom Cruise nach. Mithilfe Künstlicher Intelligenz wird das Gesicht von Cruise verblüffend realistisch auf das von Hader gelegt. Solche “Deepfake”-Videos werden im Netz teilweise bejubelt – viele unterschätzen dabei aber die potenziellen Gefahren.

In den letzten zwei Jahren wurde der Begriff “Deepfake” immer gebräuchlicher. Ausschlaggebend dafür: Eine verblüffende technische Neuerung – die sogenannten “Deep Video Portraits” des Max-Planck-Instituts für Informatik Saarbrücken, die beispielsweise der Filmindustrie beim Synchronisieren von Filmen viel Aufwand ersparen könnten. Auch in der Postproduktion oder bei Videokonferenzen könnte die Innovation unterstützend zum Einsatz kommen. Was auf der einen Seite ernsthafte Grundlagenforschung ist, bietet auf der anderen Seite Raum für Missbrauch und Videomanipulation.

“Deepfakes” werden immer realistischer

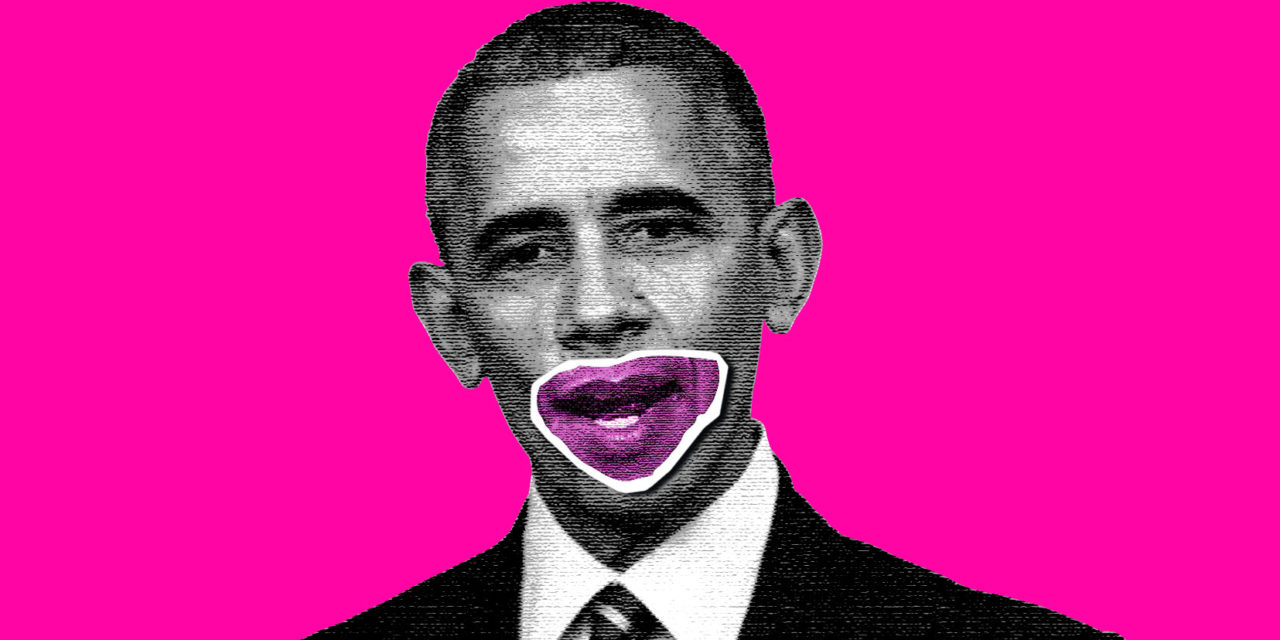

Durch Künstliche Intelligenz ist es möglich, Menschen Wörter in den Mund zu legen, Videos zu manipulieren oder sogar von Grund auf zu erzeugen, die von echten Aufnahmen kaum mehr zu unterscheiden sind. So können Reden von Politikern in ihrer Grundaussage komplett verändert werden oder gar gefälschte Pornovideos von seriösen Promis entstehen. 2017 hatte ein Reddit-Nutzer mit dem Pseudonym “Deepfakes” mehrere Pornos ins Netz gestellt. Hier waren die Gesichter von Promis wie Taylor Swift oder Emma Watson auf die Körper von Pornodarstellerinnen montiert – die Videos wurden schnell als unecht enttarnt. Das könnte in der Zukunft durch immer besser werdende technische Mittel aber immer schwieriger werden.

Lies auch: Wie geht Facebook in Zukunft mit „Deepfake“-Videos um?

“Deepfakes” als lustige Videos – harmlose Unterhaltung?

Das aktuell diskutierte “Deepfake”-Video zeigt den US-amerikanischen Schauspieler Bill Hader in einer älteren Episode der „The Late Show with David Letterman” von 2008. Während Hader über die Entstehung des Films “Tropic Thunder” spricht, imitiert er seinen Kollegen Tom Cruise. Haders Gesicht transformiert nahtlos in das von Cruise, als würde der echte Tom Cruise plötzlich dort sitzen. Später werden Eindrücke von Seth Rogen wiedergegeben und auch in dieses Gesicht verwandelt sich Hader beim Erzählen. Es ist erstaunlich, wie sich das Gehirn täuschen lässt, wie weit die technischen Möglichkeiten sind und gleichzeitig erschreckend, wenn man bedenkt, wie einfach es so möglich ist, Zuschauer zu täuschen. Wo hört die Unterhaltung auf und wo beginnt der Ernst?

Das Video stammt vom slowakischen “Deepfake”-Videos Hersteller und YouTuber “ctrl shift face”. “Deepfakes” seien Fenster zu Paralleluniversen, schreibt er in seiner Kanalinfo auf YouTube. Er würde unterhaltende “Deepfake”-Videos kreieren. Man solle nicht alles glauben, was man im Internet sieht. Über 183.500 Abonnenten zählt sein Kanal, das Hader-Cruise-Video hat bisher rund 2,6 Millionen Aufrufe, ein anderes “Deepfake” von Hader aus dem Mai (2019) sogar fast 8 Millionen Klicks. Kein Zweifel – die Videos des Slowaken polarisieren. In den Kommentaren wird er häufig für seine feine, exzellente Arbeit gelobt. Viele bezeichnen seine Kunst aber auch als beängstigend – einige User fragen sich, was sie denn noch glauben könnten.

Auch interessant: Faktencheck: So kannst du dich gegen Fake-News wehren

Realitätsverlust: “Deepfakes” fördern Misstrauen

Wichtig ist der Unterschied zwischen der Technologie “Deep Video Portraits” und den “Deepfake”-Videos, damit die Realität nicht gänzlich verloren geht. Man solle nicht alles glauben, was man im Internet sieht, schreibt “Deepfake”-Videos Produzent “ctrl shift face”. Und genau hier liegt das Problem. Der Experte Aviv Ovadya warnte bereits im November 2018 im Gespräch mit dem “Guardian”, dass “Deepfakes” dazu führen können, dass die Menschen allem misstrauen, was sie sehen oder hören. Wenn alles eine Fälschung ist, dann glaubt man besser gar nichts mehr – könnten manche denken. Die Menschen müssen über diese Technologien aufgeklärt werden und sie müssen aufmerksam bleiben.

Auch interessant: So erkennen Profis manipulierte Fotos – und so erkennt sie auch der Laie

Von David Sander/RND/RND